The Best Fluffy Pancakes recipe you will fall in love with. Full of tips and tricks to help you make the best pancakes.

Deux examinateurs virtuels face à une production écrite du DELF B2

Dans le cadre de notre réflexion sur l’usage des outils d’intelligence artificielle en évaluation, nous avons choisi de concevoir deux examinateurs virtuels, deux GPT programmés, afin d’évaluer une production écrite de niveau DELF B2.

Ces deux examinateurs ont été programmés de manière strictement identique : mêmes paramètres, même grille d’évaluation officielle, mêmes consignes de correction. L’objectif de cette expérimentation était d’observer si, dans ces conditions contrôlées, les deux systèmes produiraient des évaluations similaires.

Une même production écrite a donc été soumise aux deux examinateurs. Les résultats obtenus révèlent toutefois certaines divergences.

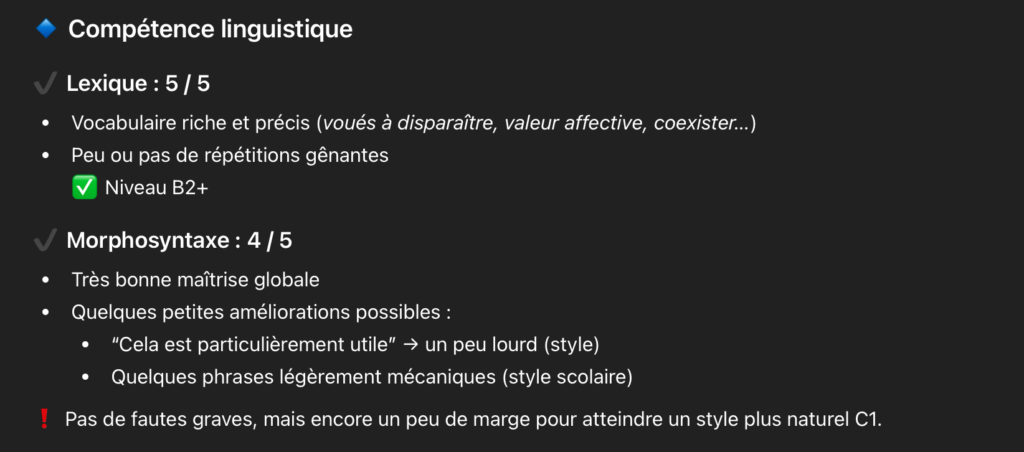

Le premier examinateur a attribué une note de 24 sur 25, accompagnée d’une évaluation globalement positive. Cependant, une anomalie apparaît dans le détail de la notation : pour le critère de morphosyntaxe, il a accordé 4 points sur 5. Or, la grille officielle du DELF B2 ne prévoit pas ce type de notation intermédiaire, le barème proposant généralement des paliers tels que 3 ou 5 points. Cette attribution témoigne donc d’une adaptation non conforme aux critères officiels.

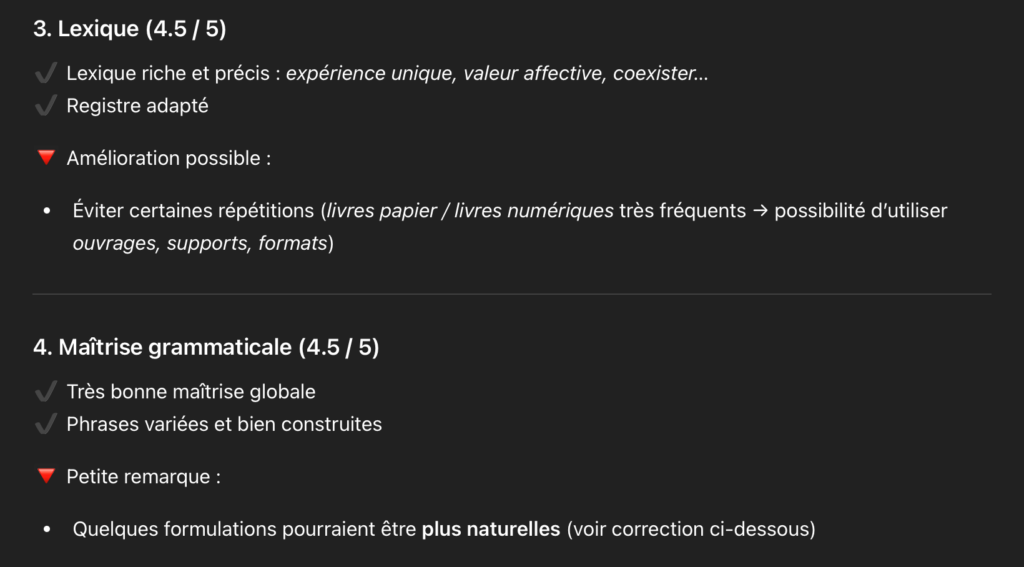

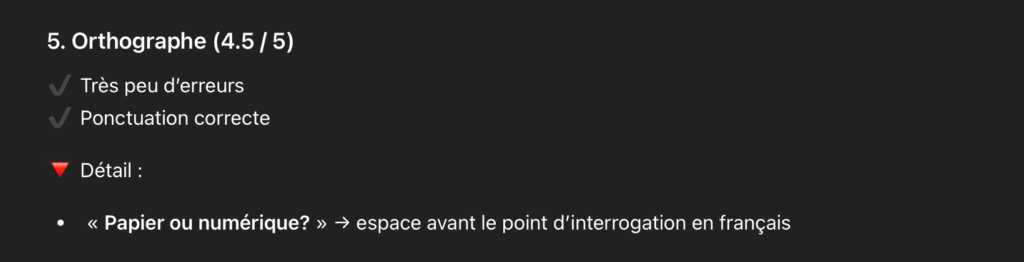

Le second examinateur a, quant à lui, attribué une note de 23 sur 25. Bien que proche de la première, cette évaluation présente également des irrégularités. D’une part, un critère supplémentaire, intitulé « maîtrise grammaticale », a été introduit, alors qu’il ne figure pas dans la grille officielle et qu’il recoupe en partie d’autres critères existants. D’autre part, l’examinateur a utilisé des demi-points (par exemple 4,5 sur 5), ce qui n’est pas prévu dans le système d’évaluation du DELF B2.

Ainsi, malgré une programmation identique, les deux examinateurs virtuels ont produit des évaluations qui s’écartent, chacune à leur manière, du cadre officiel. Ces écarts se manifestent à la fois dans la définition des critères et dans l’attribution des points.

Néanmoins, les notes globales attribuées (23 et 24 sur 25) restent cohérentes avec la qualité générale de la production, qui peut être considérée comme très satisfaisante. Il est même envisageable, au regard des exigences du niveau B2, que cette production puisse obtenir la note maximale de 25 sur 25. Les éléments relevés par les deux examinateurs ne semblent pas constituer des erreurs suffisamment significatives pour justifier une telle pénalisation. On peut donc supposer que les deux systèmes ont adopté une posture légèrement trop exigeante.

Cette expérimentation met en lumière certaines limites des examinateurs virtuels, notamment leur tendance à s’écarter des consignes normatives, que ce soit par l’ajout de critères inexistants ou par la modification de l’échelle de notation.

Il apparaît dès lors nécessaire de poursuivre le travail de paramétrage et de régulation de ces outils, afin de garantir un respect strict des grilles officielles d’évaluation.

En conclusion, si les examinateurs virtuels se montrent capables de produire des évaluations globalement pertinentes, leur fiabilité reste conditionnée par un encadrement rigoureux. Leur utilisation dans un contexte certificatif comme celui du DELF B2 suppose donc encore des ajustements afin d’assurer la validité et la conformité des évaluations proposées.